Tác giả: Haziqa Sajid

Được xuất bản cách đây 6 giây vào ngày 13 tháng 5 năm 2024

**Thời Đại của AI Tạo Sinh (GenAI) đang chuyển đổi cách chúng ta làm việc và sáng tạo. Từ viết nội dung tiếp thị đến tạo ra các thiết kế sản phẩm, những công cụ mạnh mẽ này có tiềm năng lớn. Tuy nhiên, sự đổi mới nhanh chóng này đi kèm với một mối đe dọa tiềm ẩn: rò rỉ dữ liệu. Không giống như phần mềm truyền thống, các ứng dụng GenAI tương tác và học hỏi từ dữ liệu mà chúng ta cung cấp cho chúng.

Nghiên cứu của LayerX tiết lộ rằng 6% người lao động đã sao chép và dán thông tin nhạy cảm vào các công cụ GenAI, và 4% làm điều này hàng tuần.

Điều này đặt ra một mối quan tâm quan trọng – khi GenAI trở nên tích hợp hơn vào các quy trình làm việc của chúng ta, liệu chúng ta có đang vô tình tiết lộ những dữ liệu quý giá nhất của mình?

Hãy xem xét rủi ro ngày càng tăng của việc rò rỉ thông tin trong các giải pháp GenAI và các biện pháp ngăn ngừa cần thiết để triển khai AI một cách an toàn và có trách nhiệm.

Rò Rỉ Dữ Liệu trong AI Tạo Sinh là Gì?

Rò rỉ dữ liệu trong AI Tạo Sinh đề cập đến việc phơi bày hoặc truyền tải thông tin nhạy cảm mà không được phép thông qua các tương tác với các công cụ GenAI. Điều này có thể xảy ra theo nhiều cách, từ việc người dùng vô tình sao chép và dán dữ liệu bí mật vào các lời nhắc đến việc mô hình AI tự ghi nhớ và có khả năng tiết lộ những đoạn thông tin nhạy cảm.

Ví dụ, một chatbot sử dụng GenAI tương tác với toàn bộ cơ sở dữ liệu của công ty có thể vô tình tiết lộ các chi tiết nhạy cảm trong các phản hồi của nó. Báo cáo của Gartner nêu bật các rủi ro đáng kể liên quan đến rò rỉ dữ liệu trong các ứng dụng GenAI. Báo cáo này chỉ ra sự cần thiết của việc triển khai các giao thức quản lý và bảo mật dữ liệu để ngăn ngừa việc thông tin quan trọng như dữ liệu cá nhân bị xâm phạm.

Những Nguy Hiểm của Rò Rỉ Dữ Liệu trong GenAI

Rò rỉ dữ liệu là một thách thức nghiêm trọng đối với sự an toàn và việc triển khai tổng thể của AI Tạo Sinh (GenAI). Không giống như các vi phạm dữ liệu truyền thống, thường liên quan đến các nỗ lực tấn công từ bên ngoài, rò rỉ dữ liệu trong GenAI có thể là ngẫu nhiên hoặc không cố ý. Theo báo cáo của Bloomberg, một khảo sát nội bộ của Samsung đã phát hiện rằng 65% số người được khảo sát coi AI Tạo Sinh là một rủi ro an ninh. Điều này nhấn mạnh vấn đề an ninh kém của hệ thống do lỗi người dùng và thiếu nhận thức.

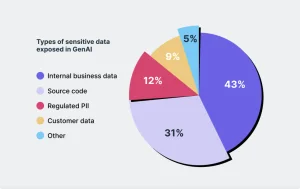

Các tác động của việc rò rỉ dữ liệu trong GenAI vượt xa những thiệt hại kinh tế đơn thuần. Thông tin nhạy cảm, chẳng hạn như dữ liệu tài chính, thông tin cá nhân (PII), thậm chí là mã nguồn hoặc kế hoạch kinh doanh bí mật, có thể bị lộ thông qua các tương tác với các công cụ GenAI. Điều này có thể dẫn đến các hậu quả tiêu cực như tổn hại danh tiếng và tổn thất tài chính.

Hậu Quả của Rò Rỉ Dữ Liệu đối với Doanh Nghiệp

Rò rỉ dữ liệu trong GenAI có thể gây ra nhiều hậu quả khác nhau cho doanh nghiệp, ảnh hưởng đến uy tín và vị thế pháp lý của họ. Dưới đây là các rủi ro chính:

Mất Tài Sản Trí Tuệ

Các mô hình GenAI có thể vô tình ghi nhớ và tiềm ẩn rò rỉ dữ liệu nhạy cảm mà chúng đã được huấn luyện. Điều này có thể bao gồm bí mật thương mại, mã nguồn, và kế hoạch kinh doanh bí mật, mà các công ty đối thủ có thể lợi dụng để chống lại công ty.

Vi Phạm Quyền Riêng Tư & Niềm Tin của Khách Hàng

Dữ liệu khách hàng mà công ty được tin tưởng lưu trữ, chẳng hạn như thông tin tài chính, chi tiết cá nhân, hoặc hồ sơ y tế, có thể bị lộ qua các tương tác với GenAI. Điều này có thể dẫn đến trộm cắp danh tính, tổn thất tài chính cho khách hàng, và suy giảm uy tín thương hiệu.

Hậu Quả Pháp Lý & Quy Định

Rò rỉ dữ liệu có thể vi phạm các quy định bảo vệ dữ liệu như GDPR, HIPAA, và PCI DSS, dẫn đến việc bị phạt và các vụ kiện tiềm năng. Doanh nghiệp cũng có thể đối mặt với các hành động pháp lý từ phía khách hàng có quyền riêng tư bị xâm phạm.

Tổn Hại Uy Tín

Tin tức về rò rỉ dữ liệu có thể gây tổn hại nghiêm trọng đến uy tín của công ty. Khách hàng có thể chọn không kinh doanh với một công ty bị coi là không an toàn, dẫn đến mất lợi nhuận và do đó làm giảm giá trị thương hiệu.

Nghiên Cứu Tình Huống: Rò Rỉ Dữ Liệu Lộ Thông Tin Người Dùng trong Ứng Dụng AI Tạo Sinh

Vào tháng 3 năm 2023, OpenAI, công ty đứng sau ứng dụng AI tạo sinh nổi tiếng ChatGPT, đã gặp phải một vụ rò rỉ dữ liệu do lỗi trong một thư viện mã nguồn mở mà họ dựa vào. Sự cố này buộc họ phải tạm thời đóng cửa ChatGPT để giải quyết vấn đề bảo mật. Vụ rò rỉ dữ liệu đã lộ ra một chi tiết đáng lo ngại – thông tin thanh toán của một số người dùng đã bị xâm phạm. Ngoài ra, tiêu đề của lịch sử trò chuyện của người dùng đang hoạt động đã trở nên có thể nhìn thấy đối với những cá nhân không được phép.

Thách Thức trong Việc Giảm Thiểu Rủi Ro Rò Rỉ Dữ Liệu

Đối phó với các rủi ro rò rỉ dữ liệu trong môi trường GenAI mang đến những thách thức độc đáo cho các tổ chức. Dưới đây là một số trở ngại chính:

1. Thiếu Hiểu Biết và Nhận Thức

Vì GenAI vẫn đang phát triển, nhiều tổ chức chưa hiểu rõ các rủi ro rò rỉ dữ liệu tiềm ẩn của nó. Nhân viên có thể không biết về các giao thức đúng đắn để xử lý dữ liệu nhạy cảm khi tương tác với các công cụ GenAI.

2. Biện Pháp Bảo Mật Không Hiệu Quả

Các giải pháp bảo mật truyền thống được thiết kế cho dữ liệu tĩnh có thể không bảo vệ hiệu quả các quy trình làm việc động và phức tạp của GenAI. Việc tích hợp các biện pháp bảo mật mạnh mẽ với cơ sở hạ tầng GenAI hiện có có thể là một nhiệm vụ phức tạp.

3. Độ Phức Tạp của Hệ Thống GenAI

Các hoạt động bên trong của các mô hình GenAI có thể không rõ ràng, làm cho việc xác định chính xác nơi và cách rò rỉ dữ liệu có thể xảy ra trở nên khó khăn. Sự phức tạp này gây ra vấn đề trong việc triển khai các chính sách mục tiêu và các chiến lược hiệu quả.

Tại Sao Các Nhà Lãnh Đạo AI Nên Quan Tâm

Rò rỉ dữ liệu trong GenAI không chỉ là một trở ngại kỹ thuật. Thay vào đó, nó là một mối đe dọa chiến lược mà các nhà lãnh đạo AI phải giải quyết. Bỏ qua rủi ro này sẽ ảnh hưởng đến tổ chức của bạn, khách hàng của bạn, và toàn bộ hệ sinh thái AI.

Sự gia tăng trong việc áp dụng các công cụ GenAI như ChatGPT đã thúc đẩy các nhà lập pháp và các cơ quan quản lý xây dựng các khung quản trị. Các biện pháp bảo mật và bảo vệ dữ liệu nghiêm ngặt đang được áp dụng ngày càng nhiều do lo ngại ngày càng tăng về các vụ vi phạm và tấn công dữ liệu. Các nhà lãnh đạo AI có nguy cơ đặt công ty của họ vào tình trạng nguy hiểm và cản trở sự tiến bộ và triển khai có trách nhiệm của GenAI nếu không giải quyết các rủi ro rò rỉ dữ liệu.

Các nhà lãnh đạo AI có trách nhiệm phải chủ động. Bằng cách thực hiện các biện pháp bảo mật mạnh mẽ và kiểm soát các tương tác với các công cụ GenAI, bạn có thể giảm thiểu rủi ro rò rỉ dữ liệu. Hãy nhớ rằng, AI an toàn là thực hành tốt và là nền tảng cho một tương lai AI phát triển.

Các Biện Pháp Chủ Động để Giảm Thiểu Rủi Ro

Rò rỉ dữ liệu trong GenAI không phải là điều chắc chắn. Các nhà lãnh đạo AI có thể giảm thiểu rủi ro đáng kể và tạo ra một môi trường an toàn để áp dụng GenAI bằng cách thực hiện các biện pháp chủ động. Dưới đây là một số chiến lược quan trọng:

1. Đào Tạo Nhân Viên và Chính Sách

Thiết lập các chính sách rõ ràng nêu rõ các quy trình xử lý dữ liệu đúng cách khi tương tác với các công cụ GenAI. Cung cấp đào tạo để giáo dục nhân viên về các thực hành bảo mật dữ liệu tốt nhất và hậu quả của việc rò rỉ dữ liệu.

2. Giao Thức Bảo Mật Mạnh và Mã Hóa

Thực hiện các giao thức bảo mật mạnh mẽ được thiết kế đặc biệt cho các quy trình làm việc của GenAI, chẳng hạn như mã hóa dữ liệu, kiểm soát truy cập và đánh giá lỗ hổng thường xuyên. Luôn chọn các giải pháp có thể dễ dàng tích hợp với cơ sở hạ tầng GenAI hiện có của bạn.

3. Kiểm Toán và Đánh Giá Thường Xuyên

Thường xuyên kiểm toán và đánh giá môi trường GenAI của bạn để tìm các lỗ hổng tiềm ẩn. Cách tiếp cận chủ động này cho phép bạn xác định và giải quyết bất kỳ khoảng trống bảo mật dữ liệu nào trước khi chúng trở thành các vấn đề nghiêm trọng.

Tương Lai của GenAI: An Toàn và Phát Triển

AI Tạo Sinh (GenAI) mang lại tiềm năng to lớn, nhưng rò rỉ dữ liệu có thể là một rào cản. Các tổ chức có thể giải quyết thách thức này bằng cách ưu tiên các biện pháp bảo mật đúng đắn và nâng cao nhận thức cho nhân viên. Một môi trường GenAI an toàn có thể mở đường cho một tương lai tốt đẹp hơn, nơi các doanh nghiệp và người dùng đều có thể hưởng lợi từ sức mạnh của công nghệ AI này.