Bởi Ben Dickson – 28 tháng 8 năm 2023

“Một công việc tinh chỉnh (fine-tuning) với một tập tin huấn luyện chứa 100.000 token và được huấn luyện trong 3 vòng lặp có thể có chi phí dự kiến là 2,40 đô la.”

OpenAI đã giới thiệu tính năng tinh chỉnh (fine-tuning) cho mô hình GPT-3.5 Turbo, cung cấp sức mạnh cho phiên bản miễn phí của ChatGPT, mô hình ngôn ngữ lớn phổ biến của họ. Tính năng mới này cho phép các nhà phát triển và doanh nghiệp tùy chỉnh mô hình cho các trường hợp sử dụng cụ thể. Điều này mở rộng phạm vi ứng dụng của ChatGPT và đưa ra một lý do kinh doanh mạnh mẽ hơn cho LLM bằng cách giảm chi phí hoạt động.

Vào cuối năm nay, OpenAI kế hoạch mở rộng khả năng điều chỉnh tinh vi tương tự cho GPT-4, mô hình đứng sau ChatGPT Plus mạnh mẽ hơn. Sự triển khai này cho thấy sự mở rộng của thị trường cho các mô hình ngôn ngữ lớn, với các phân thị trường mới liên tục nổi lên. Khi nhu cầu về các LLM chuyên biệt tăng lên, chúng ta có thể dự kiến sự gia tăng cạnh tranh, thúc đẩy thêm sự đổi mới và tiến bộ trong lĩnh vực này.

Tinh chỉnh (fine-tuning) cho ChatGPT

Các mô hình ngôn ngữ lớn như ChatGPT đã được thiết kế để thực hiện nhiều nhiệm vụ khác nhau, bao gồm cả những nhiệm vụ mà chúng không được huấn luyện cụ thể. Bài báo gốc về GPT-3 đã đề xuất rằng việc tỉ lệ mô hình lên hàng trăm tỷ tham số và huấn luyện nó với dữ liệu phù hợp có thể cho phép nó học các nhiệm vụ mới thông qua việc học qua vài ví dụ, bổ sung thông tin từ bộ nhớ và kỹ thuật đặt câu hỏi, mà không cần phải điều chỉnh tham số.

Tuy nhiên, trong thực tế, các mô hình như ChatGPT có thể không đáng tin cậy đối với một số nhiệm vụ, ngay cả khi áp dụng tất cả các kỹ thuật kỹ thuật đặt câu hỏi đã biết. Trong những trường hợp như vậy, một giải pháp là điều chỉnh tinh vi cho LLM.

Cho đến gần đây, GPT-3.5 Turbo không có khả năng tinh chỉnh. Tuy nhiên, OpenAI hiện đã thêm hỗ trợ cho việc điều chỉnh tinh vi cho GPT-3.5 Turbo với ngữ cảnh 4k. Theo blog của OpenAI, hỗ trợ điều chỉnh tinh vi cho mô hình 16k và GPT-4 sẽ được bổ sung trong tương lai.

Hiện tại, việc điều chỉnh tinh vi có thể được thực hiện thông qua các cuộc gọi API, nhưng OpenAI có kế hoạch giới thiệu một giao diện người dùng trực tuyến thân thiện hơn trong tương lai. Sự giới thiệu của việc điều chỉnh tinh vi mở ra những cơ hội mới cho các doanh nghiệp. Nó có thể dẫn đến việc theo dõi hướng dẫn tốt hơn và tùy chỉnh phong cách, cho phép các doanh nghiệp triển khai các chatbot nội bộ riêng và các ứng dụng khác được cung cấp sức mạnh từ các mô hình ChatGPT được điều chỉnh tinh vi.

Liệu việc điều chỉnh tinh vi cho ChatGPT có hiệu quả về chi phí không?

Một trong những lợi ích của việc tinh chỉnh (fine-tuning) cho ChatGPT là giảm thiểu chi phí sử dụng LLM bằng cách cho phép các nhà phát triển đạt được các phản hồi phù hợp với các prompt ngắn hơn. Theo OpenAI, “Các nhà thử nghiệm sớm đã giảm kích thước prompt lên đến 90% bằng cách điều chỉnh tinh vi hướng dẫn vào mô hình chính nó, làm tăng tốc độ mỗi cuộc gọi API và cắt giảm chi phí.”

Tuy nhiên, việc tính toán chi phí không hề đơn giản. Chi phí để tinh chỉnh (fine-tuning) cho mô hình này là 0,008 đô la cho mỗi ngàn token, khoảng bốn đến năm lần so với chi phí suy luận với GPT-3.5 Turbo 4k. Theo OpenAI, “Một công việc điều chỉnh tinh vi với một tập tin huấn luyện chứa 100.000 token và được huấn luyện trong 3 vòng lặp có thể có chi phí dự kiến là 2,40 đô la.”

Số lượng dữ liệu và số vòng lặp cần thiết để điều tinh chỉnh cho mô hình sẽ phụ thuộc chủ yếu vào ứng dụng mục tiêu và mức độ tương đồng với dữ liệu huấn luyện gốc của ChatGPT. Nhưng việc điều chỉnh tinh vi là một chi phí một lần và nếu được thực hiện đúng cách, nó có thể dẫn đến việc tiết kiệm lớn qua hàng loạt tương tác với mô hình.

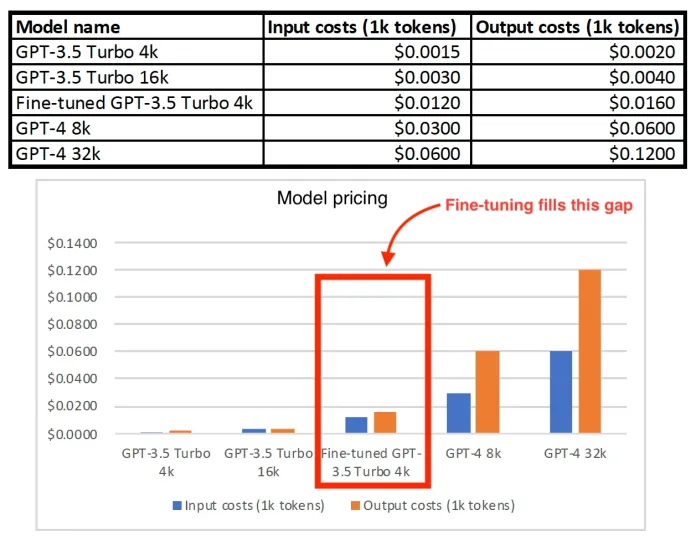

Những thử nghiệm sớm của OpenAI đã chứng minh rằng phiên bản được tinh chỉnh của GPT-3.5 Turbo có thể phù hợp hoặc thậm chí vượt qua khả năng của GPT-4 cơ bản trong một số nhiệm vụ cụ thể. Chi phí sử dụng cho ChatGPT được tinh chỉnh là 0,012 đô la cho mỗi ngàn token đầu vào và 0,016 đô la cho mỗi ngàn token đầu ra. Mức giá này đặt nó ở mức nửa đến một phần tư giá của GPT-4, nhưng vẫn khoảng tám lần giá của mô hình GPT-3.5 Turbo tiêu chuẩn với ngữ cảnh 4k.

Vì vậy, tính hiệu quả về chi phí của việc tinh chỉnh chủ yếu phụ thuộc vào trường hợp sử dụng cụ thể. Tuy nhiên, việc giới thiệu tính năng này không thể phủ nhận đã làm phong phú thêm các tùy chọn giá cả cho các nhà phát triển và doanh nghiệp và điền vào khoảng trống giữa GPT-3.5 và GPT-4.

GPT-3.5 Turbo 4k là mô hình ChatGPT có giá phải chăng nhất. Nó phù hợp cho các nhiệm vụ đơn giản có thể hoàn thành bằng kỹ thuật đặt câu hỏi cơ bản và tối thiểu hoá bổ sung thông tin từ bộ nhớ.

GPT-3.5 Turbo 16k có giá gấp đôi mô hình cơ bản nhưng cung cấp nhiều không gian hơn cho kỹ thuật đặt câu hỏi và ngữ cảnh. Điều này làm cho nó hữu ích cho các ứng dụng có thể được quản lý với các hướng dẫn chi tiết và bổ sung thông tin từ bộ nhớ mở rộng. Mặc dù nó rẻ hơn so với mô hình được điều chỉnh tinh vi, nhu cầu về hướng dẫn và kỹ thuật đặt câu hỏi nhiều hơn có thể dẫn đến chi phí tương tự hoặc thậm chí cao hơn. Nó có thể phục vụ như một điểm khởi đầu tốt để khám phá khả năng của ChatGPT cho ứng dụng của bạn và có thể tạo dữ liệu để sau này điều chỉnh tinh vi.

Mô hình GPT-3.5 Turbo 4k được điều tin chỉnh tinh với ngữ cảnh 4k là thành viên mới của gia đình. Nó có giá cao hơn so với các mô hình cơ bản nhưng yêu cầu ít hướng dẫn và kỹ thuật đặt câu hỏi hơn. Nếu bạn có tập dữ liệu huấn luyện chất lượng cao, mô hình này có thể là một lựa chọn tuyệt vời cho các ứng dụng cụ thể, điều thường xảy ra đối với doanh nghiệp và doanh nghiệp. Nó cũng là một lựa chọn khả thi nếu bạn hiện đang sử dụng GPT-4 và đang tìm kiếm một giải pháp thay thế giá rẻ hơn.

Cuối cùng, GPT-4 8k với 32k là những mô hình mạnh mẽ và đắt đỏ nhất. Chúng là một điểm khởi đầu tốt để khám phá tiềm năng của các mô hình ngôn ngữ lớn và tạo dữ liệu để điều chỉnh tinh vi cho GPT-3.5 Turbo, từ đó giảm thiểu chi phí.

Thị trường mô hình ngôn ngữ lớn chuyên biệt đang phát triển rất nhanh

Bức tranh mô hình ngôn ngữ lớn luôn biến đổi liên tục, với thị trường liên tục mở rộng và tiến hóa. Một phân khúc đang nổi lên là mô hình được tinh chỉnh cho lĩnh vực chuyên biệt. Thời kỳ “một mô hình để cai trị tất cả” đang nhường chỗ cho một mô hình mới, ở đó các mô hình có thể được tùy chỉnh hoặc tinh chỉnh cho các nhiệm vụ cụ thể ở mức chi phí tối thiểu.

OpenAI đã nhận thức được sự chuyển đổi như phát biểu: “các nhà phát triển và doanh nghiệp đã yêu cầu khả năng tùy chỉnh mô hình để tạo ra những trải nghiệm duy nhất và khác biệt cho người dùng.”

Trong năm nay, việc phát hành một số LLM mã nguồn mở, được tinh chỉnhđể theo dõi hướng dẫn, đã cung cấp lựa chọn thay thế ChatGPT. Những mô hình này, có thể được dễ dàng tinh chỉnh (fine-tuning) bằng dữ liệu độc quyền, đã bắt đầu ăn tấn công mạnh mẽ vào thị phần của ChatGPT.

Với việc giới thiệu khả năng điều chỉnh tinh vi cho GPT-3.5 Turbo, OpenAI đang đáp ứng các yêu cầu thay đổi nêu trên nhằm đảm bảo mình duy trì vị trí cạnh tranh. Với ưu điểm dễ sử dụng, đặc biệt khi OpenAI triển khai thêm các tính năng điều tinh chỉnh thân thiện với người dùng, là một lợi thế quan trọng.

Tuy nhiên, chính sách của OpenAI không mở mã nguồn mô hình và yêu cầu tất cả mọi thứ chạy trên máy chủ của họ hoặc Microsoft Azure có thể khiến một số công ty lựa chọn các mô hình mã nguồn mở. Thị trường đang thay đổi liên tục, và chúng ta có thể dự đoán sớm xuất hiện thêm những thay đổi khác trong các mô hình và công cụ sẵn có hiện nay.

Để đối phó với những diễn biến này, việc có một hệ thống thu thập dữ liệu mạnh mẽ và duy trì một hồ sơ toàn diện về dữ liệu được sử dụng cho việc điều chỉnh tinh vi là rất quan trọng. Cách tiếp cận này sẽ giúp bạn linh hoạt và tránh bị ràng buộc bởi một mô hình hoặc nhà cung cấp cụ thể, đảm bảo bạn có thể thích nghi với thị trường thay đổi liên tục cho các mô hình ngôn ngữ lớn chuyên biệt.