Tác giả: Tiến sĩ Assad Abbas

Ngày 29 tháng 11 năm 2023

Cần có một hiểu biết toàn diện về thông tin sai lệch trong quá trình bầu cử dân chủ. Thông tin sai lệch trong bầu cử liên quan đến việc lan truyền chủ ý thông tin sai lệch để chi phối ý kiến công dân và làm suy yếu tính chân thực của cuộc bầu cử, đe dọa trực tiếp đến những nguyên tắc cơ bản của nền dân chủ. Nhìn vào lịch sử, chúng ta có thể thấy rằng can thiệp vào cuộc bầu cử đã trở nên phức tạp hơn theo thời gian. Do đó, những mối đe dọa gia tăng đối với quá trình dân chủ đặt ra nhu cầu cấp bách về những biện pháp chống lại mạnh mẽ. Nhận thức về bối cảnh lịch sử này là quan trọng để xây dựng những chiến lược hiệu quả nhằm đối mặt với những thách thức đương đại do sự phổ biến ác ý của thông tin sai lệch.

Trong các cuộc bầu cử hiện đại, vai trò quan trọng của Trí tuệ Nhân tạo (AI) đóng vai trò trung tâm, đóng góp như một yếu tố quyết định để đảm bảo sự công bằng và minh bạch. Các công nghệ AI, bao gồm phân tích dữ liệu lớn và nhận diện mô hình, cung cấp thông tin quý báu, từ đó bảo vệ quá trình bầu cử khỏi sự chi phối.

Ở trung tâm của việc đối mặt với thông tin sai lệch là sự xuất hiện của những “người gác cổng” AI. Những người gác cổng AI là hệ thống tự động sử dụng công nghệ AI để giám sát, phân tích và quy định các hoạt động hoặc lĩnh vực cụ thể với xem xét về đạo đức. Trong bối cảnh quá trình bầu cử, những người gác cổng AI được biểu tượng hóa là các hệ thống dựa trên AI để đối phó với các trường hợp thông tin sai lệch nhằm bảo vệ tính chân thực của cuộc bầu cử.

Nhìn lại vào quá khứ gần đây, kết quả cuộc bầu cử tổng thống Hoa Kỳ năm 2016 khiến chúng ta khám phá những yếu tố nào ảnh hưởng đến quyết định của cử tri. Phân tích từ góc độ của cả ứng viên chiến thắng và thất bại thường làm nổi bật những động lực thường bị bỏ qua. Đặc biệt, quan điểm của ứng viên thất bại, chủ yếu như được thể hiện trong cuốn hồi ký của cô ấy, mở lời về ảnh hưởng của thông tin sai lệch trong cuộc bầu cử đối với tâm lý công dân và sự biến đổi của động lực chính trị.

Tương tự, một báo cáo của Byline Times vào ngày 20 tháng 11 năm 2023, làm nổi bật những lo ngại quan trọng xoay quanh các cơ quan giám sát bầu cử ở Vương quốc Anh. Báo cáo nêu bật sự hạn chế về quyền lực của những cơ quan này trong việc đối mặt với nội dung ‘deepfake’, do đó tiết lộ những điểm yếu về các video giả mạo được tạo ra bằng Trí tuệ Nhân tạo có thể ảnh hưởng đến động lực chính trị. Theo báo cáo, deepfakes do AI tạo ra và nhắm đến các nhân vật chính trị đã đổ chuông báo động, nâng cao ý thức về khả năng bị chi phối trong các cuộc bầu cử. Sự mơ hồ về tính hợp pháp của nội dung này thêm vào đó một lớp phức tạp cho các nỗ lực quy định.

Ủy ban Bầu cử Anh, có trách nhiệm quy định tài chính chiến dịch, không có thẩm quyền đối với deepfakes, đặt ra yêu cầu về quyền lực đặc biệt hơn. Điều này nhấn mạnh sự quan trọng của các nỗ lực cộng tác và các khung pháp quy định cập nhật để đối mặt với những mối đe dọa mới nổi, đồng thời nhận thức về vai trò quan trọng của những người gác cổng AI trong bảo vệ quá trình dân chủ.

Giải quyết những sự phức tạp nêu trên là quan trọng để các đảng chính trị hiểu rõ các yếu tố đa dạng ảnh hưởng đến cử tri. Trong bối cảnh này, việc nhận thức về vai trò quan trọng của những người gác cổng AI trong đối phó với thông tin sai lệch trong bầu cử là quan trọng, làm nổi bật tư thế tích cực của họ và đóng góp vào sự kiên cường của hệ thống dân chủ.

Sự Tiến Hóa của Chiến Thuật Lừa Dối trong Thời Đại Thông Tin

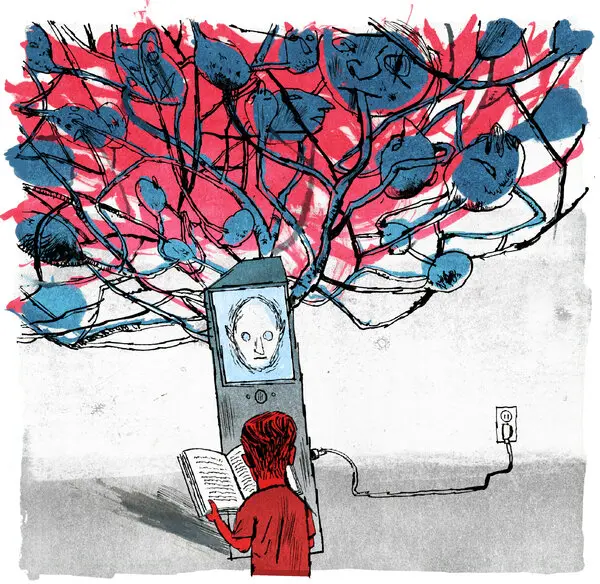

Sự tiến triển của các chiến thuật lừa dối trong việc lan truyền thông tin sai lệch là một đe dọa kiên cường đối với xã hội trong thời đại thông tin này. Các hình thức sớm của sự manipulasi thường được lan truyền thông qua các phương tiện truyền thống đã được thay thế bằng các chiến lược trực tuyến hiện đại và các chiến thuật truyền thông xã hội. Những nền tảng này tạo điều kiện cho việc phổ biến nhanh chóng các câu chuyện không chính xác và sự manipulasi có mục tiêu nhằm khuếch đại thông tin sai lệch.

Khi công nghệ tiến bộ, cuộc chiến không ngừng giữa những người lan truyền thông tin sai lệch và những người đứng ra phòng thủ trở nên quyết liệt hơn, đòi hỏi những biện pháp phản kháng linh hoạt. Thông tin sai lệch trong bầu cử, đe dọa đến những nguyên tắc cơ bản của dân chủ, hoàn toàn ngược lại với các quy chuẩn dân chủ. Thông tin sai lệch tạo ra sự nghi ngờ và xung đột trong cộng đồng công dân, làm giảm sự tự tin của họ vào quá trình dân chủ. Điều này đưa ra lo ngại và nghi ngờ trong tâm trí của người dân về hệ thống dân chủ và có thể dẫn đến sự xói mòn giá trị. Do đó, nhu cầu đối phó với các ảnh hưởng có hại của thông tin lạc hậu trong bầu cử để bảo vệ dân chủ tăng lên hơn bao giờ hết.

Vai Trò Quan Trọng của Những Người Gác Cổng AI

Trong việc bảo vệ cuộc bầu cử, những người gác cổng Trí tuệ Nhân tạo (AI) nổi lên như những người bảo vệ có trách nhiệm quan sát, phân tích và đối phó với thông tin sai lệch. Mục tiêu chính của họ là tăng cường tính chân thực của quá trình bầu cử, duy trì tính kiên cường trước sự lan truyền vô hình vô cảm của thông tin sai lệch. Những người gác cổng AI sử dụng các công nghệ tiên tiến, đặc biệt là các thuật toán học máy và học sâu, để đối phó với lượng thông tin sai lệch liên quan đến cuộc bầu cử ngày càng tăng. Những công cụ này cho phép giám sát thời gian thực, liên tục thích nghi để nhận diện và ngăn chặn các chiến lược thay đổi được sử dụng bởi các đối tượng có ý đồ xấu. Tính linh hoạt của những thuật toán này tăng cường hiệu suất của chúng trong việc nhận diện và giảm nhẹ các mối đe dọa mới xuất hiện đối với tính chân thực của cuộc bầu cử. Trong số các kỹ thuật được sử dụng để chống lại thông tin sai lệch, xử lý ngôn ngữ tự nhiên (NLP) nổi lên như một công nghệ chuyển đổi có khả năng giải mã mẫu lừa dối trong nội dung viết. Khả năng hiểu ngôn ngữ phức tạp của NLP giúp các hệ thống AI diễn giải và ngữ cảnh hóa thông tin, nâng cao đáng kể khả năng của chúng trong việc hiệu quả phát hiện và chống lại thông tin sai lệch.

Như đã đề cập ở trên, những người gác cổng AI đóng vai trò quan trọng trong việc phòng ngừa thông tin sai lệch. Những người bảo vệ chăm chỉ này tích cực xác định, phân tích và chống lại thông tin sai lệch, bao gồm mối đe dọa ngày càng tăng về deepfakes, đóng góp tích cực vào việc duy trì tính chân thực của cuộc bầu cử. Hơn nữa, những người gác cổng AI liên tục giám sát, thích nghi với các chiến thuật tiến triển và hợp tác một cách có trách nhiệm, hiện diện như một thành phần quan trọng trong việc bảo tồn nền dân chủ.

Các phương pháp đa chiều của họ bao gồm khả năng phát hiện sớm, đối phó với sự manipulasi truyền thông xã hội thông qua các thuật toán học máy tiên tiến và các biện pháp an ninh mạng nghiêm ngặt. Những người bảo vệ này thực hiện một chức năng quan trọng trong việc xác định và ngăn chặn những mối đe dọa tiềm ẩn trong các chiến dịch hiện đại và đóng góp đáng kể vào việc giảm thiểu tác động của các câu chuyện sai lệch đối với tâm trạng công dân. Hơn nữa, việc kết hợp các hệ thống phát hiện dựa trên trí tuệ nhân tạo với các sáng kiến nhằm tăng cường ý thức của công dân và xây dựng các khung pháp luật mạnh mẽ chống lại những thách thức như deepfakes là cực kỳ quan trọng.

Để chống lại các chiến thuật lừa dối thông minh để lan truyền thông tin sai lệch trong cuộc bầu cử, việc sử dụng các phương pháp đa chiều là rất cần thiết, vì một biện pháp phản kháng duy nhất trong cảnh báo đe dọa đang phát triển có thể không đủ.

Ví dụ, các Giải pháp Kiểm chứng Sự Thật Dựa trên Thuật Toán, bao gồm cả Trí tuệ Nhân tạo có thể giải thích (XAI), đóng vai trò trung tâm bằng cách cung cấp một cái nhìn toàn diện về các kỹ thuật dựa trên trí tuệ nhân tạo. Cụ thể, XAI tăng cường tính minh bạch bằng cách cung cấp thông tin về quá trình ra quyết định của các thuật toán, từ đó tạo niềm tin trong việc kiểm chứng sự thật theo thời gian thực.

Tương tự, các đối tác hợp tác với các nền tảng truyền thông xã hội đều là chiến lược quan trọng khác, nâng cao sự hợp tác giữa các bên liên quan đến bầu cử và các nền tảng số để xác định, ghi chú và giảm nhẹ tác động của thông tin sai lệch.

Hơn nữa, các phương pháp Trí tuệ Nhân tạo Chịu trách nhiệm có thể là quan trọng trong chiến lược này, đảm bảo triển khai đạo đức của các công nghệ Trí tuệ Nhân tạo với sự tập trung vào minh bạch, trách nhiệm và công bằng. Hơn nữa, việc khuyến khích sự hiểu biết chính trị trong cộng đồng là quan trọng để trang bị cho cá nhân khả năng đánh giá một cách phê phán thông tin và đưa ra quyết định có kiến thức trong thời đại thông tin liên tục biến đổi.

Thách Thức và Xem Xét Cho Tương Lai

Mặc dù các kỹ thuật Trí tuệ Nhân tạo có khả năng đối phó với thông tin sai lệch trong bầu cử, nhưng những thách thức đang tiếp tục đòi hỏi một cách tiếp cận hướng tới tương lai. Ví dụ, tính liên tục biến đổi của các chiến thuật thông tin sai lệch, bao gồm cả sự tiến triển trong deepfake và nội dung được tạo ra bởi Trí tuệ Nhân tạo, đòi hỏi sự thích ứng liên tục. Tương tự, việc đối mặt với những thách thức đạo đức trong giám sát Trí tuệ Nhân tạo, như giảm thiểu sự chệch lệch và đảm bảo minh bạch, là quan trọng. Sự hợp tác quốc tế và tiêu chuẩn hóa cũng là quan trọng trong việc đối phó với tác động toàn cầu của thông tin sai lệch. Hơn nữa, để duy trì ưu thế trong cuộc chiến chống lại các kỹ thuật thông tin sai lệch mới nổi và bảo vệ tính chân thực của quá trình dân chủ, việc dự đoán những mối đe dọa và công nghệ trong tương lai là rất quan trọng.

Thay lời kết

Cuối cùng, nhìn chung, những người gác cổng Trí tuệ Nhân tạo là không thể thiếu trong việc bảo vệ cuộc bầu cử và thích ứng với những chiến thuật thông tin sai lệch đang tiếp tục phát triển. Những chiến thuật liên tục biến đổi đòi hỏi các bên liên quan ưu tiên các phương thức Trí tuệ Nhân tạo có trách nhiệm, tập trung vào những xem xét đạo đức và sự chịu trách nhiệm. Việc duy trì các quy chuẩn dân chủ đòi hỏi những nỗ lực tổng hợp, với những người gác cổng Trí tuệ Nhân tạo đóng vai trò quan trọng trong việc củng cố tính chân thực của quá trình bầu cử. Khi công nghệ tiến bộ, một hệ thống phòng thủ chống lại thông tin sai lệch đòi hỏi sự củng cố của sự hợp tác liên tục, nhận thức đạo đức và cam kết chung để bảo vệ quy trình dân chủ.