Tác giả: Aayush Mittal

Ngày 9 tháng 1 năm 2024

Những tiến bộ nhanh chóng trong Trí tuệ Nhân tạo sáng tạo đã gây kích thích về tiềm năng sáng tạo của công nghệ này. Tuy nhiên, những mô hình mạnh mẽ này cũng mang lại những rủi ro lo ngại về việc tái tạo nội dung bản quyền hoặc bị đạo văn mà không có sự ghi nhận đúng đắn.

Cách thức mạng Nơ-ron hấp thụ dữ liệu khi huấn luyện

Hệ thống Trí tuệ Nhân tạo hiện đại như GPT-3 được huấn luyện thông qua quá trình gọi là học chuyển giao. Chúng hấp thụ các bộ dữ liệu lớn được thu thập từ các nguồn công cộng như trang web, sách, bài nghiên cứu học thuật và nhiều nguồn khác nữa. Ví dụ, dữ liệu huấn luyện của GPT-3 bao gồm 570 gigabyte văn bản. Trong quá trình huấn luyện, Trí tuệ Nhân tạo tìm kiếm các mẫu và mối quan hệ thống kê trong hồ bơi dữ liệu lớn này. Chúng học được các tương quan giữa từ ngữ, câu, đoạn văn, cấu trúc ngôn ngữ và các đặc điểm khác.

Điều này cho phép Trí tuệ Nhân tạo tạo ra văn bản hoặc hình ảnh mới một cách có logic bằng cách dự đoán các chuỗi có khả năng xuất hiện sau một đầu vào hoặc yêu cầu cụ thể. Tuy nhiên, điều này cũng có nghĩa là những mô hình này hấp thụ nội dung mà không quan tâm đến bản quyền, việc ghi nhận đầy đủ, hoặc các rủi ro về đạo văn. Kết quả là, Trí tuệ Nhân tạo sáng tạo có thể tái tạo một cách không chủ ý các đoạn văn nguyên văn hoặc diễn đạt lại văn bản bản quyền từ các nguồn dữ liệu huấn luyện của chúng.

Ví dụ về đạo văn của trí tuệ nhân tạo

Lo ngại về đạo văn của Trí tuệ Nhân tạo đã xuất hiện nổi bật kể từ năm 2020 sau khi GPT được ra mắt.

Nghiên cứu gần đây đã chỉ ra rằng các mô hình ngôn ngữ lớn (LLMs) như GPT-3 có thể tái tạo các đoạn văn nguyên văn đáng kể từ dữ liệu huấn luyện của chúng mà không có sự trích dẫn (Nasr et al., 2023; Carlini et al., 2022). Ví dụ, một vụ kiện từ The New York Times đã tiết lộ phần mềm của OpenAI tạo ra các bài viết của The New York Times gần như nguyên văn (The New York Times, 2023).

Những phát hiện này cho thấy một số hệ thống Trí tuệ Nhân tạo sáng tạo có thể tạo ra các đầu ra đạo văn không được yêu cầu, đe dọa vi phạm bản quyền. Tuy nhiên, sự phổ biến của vấn đề này vẫn chưa rõ ràng do tính ‘hộp đen’ của các LLMs. Vụ kiện của The New York Times cho rằng các đầu ra như vậy đều là vi phạm, điều này có thể có tác động lớn đối với phát triển Trí tuệ Nhân tạo sáng tạo. Tổng cộng, bằng chứng cho thấy đạo văn là một vấn đề tồn tại trong các mô hình mạng nơ-ron lớn và đòi hỏi sự cảnh báo và biện pháp bảo vệ.

Những trường hợp này tiết lộ hai yếu tố quan trọng ảnh hưởng đến rủi ro đạo văn của Trí tuệ Nhân tạo:

- Kích thước mô hình – Các mô hình lớn như GPT-3.5 dễ tái tạo các đoạn văn nguyên văn hơn so với các mô hình nhỏ hơn. Dữ liệu huấn luyện lớn hơn của chúng tăng cơ hội tiếp xúc với tư liệu nguồn có bản quyền.

- Dữ liệu huấn luyện – Các mô hình được huấn luyện trên dữ liệu thu thập từ internet hoặc từ các tác phẩm có bản quyền (ngay cả khi được cấp phép) có khả năng đạo văn cao hơn so với các mô hình được huấn luyện trên các bộ dữ liệu được tạo ra cẩn thận.

Tuy nhiên, việc đo lường trực tiếp sự phổ biến của các đầu ra đạo văn là khó khăn. Tính ‘hộp đen’ của mạng nơ-ron làm cho việc theo dõi đầy đủ liên kết giữa dữ liệu huấn luyện và đầu ra mô hình trở nên khó khăn. Tỉ lệ có lẽ phụ thuộc nặng vào kiến trúc mô hình, chất lượng bộ dữ liệu và cách đặt câu hỏi. Nhưng những trường hợp này xác nhận rằng đạo văn của Trí tuệ Nhân tạo xảy ra không cần phải nghi ngờ, điều này mang lại những hậu quả pháp lý và đạo đức quan trọng.

Các hệ thống phát hiện đạo văn

Để đáp ứng vấn đề này, các nhà nghiên cứu đã bắt đầu khám phá các hệ thống Trí tuệ Nhân tạo để tự động phát hiện văn bản và hình ảnh được tạo ra bởi mô hình so với người tạo. Ví dụ, các nhà nghiên cứu tại Mila đã đề xuất GenFace, một hệ thống phân tích các mô hình ngôn ngữ có đặc điểm của văn bản do Trí tuệ Nhân tạo tạo ra. Công ty khởi nghiệp Anthropic cũng đã phát triển khả năng phát hiện đạo văn nội bộ cho trí tuệ nhân tạo đàm thoại của họ, Claude.

Tuy nhiên, những công cụ này có nhược điểm. Dữ liệu huấn luyện lớn của các mô hình như GPT-3 làm cho việc xác định nguồn gốc của văn bản bị đạo văn trở nên khó khăn, nếu không nói là không thể. Các kỹ thuật mạnh mẽ hơn sẽ cần được phát triển khi mô hình sáng tạo tiếp tục phát triển nhanh chóng. Cho đến khi đó, việc xem xét thủ công vẫn là quan trọng để kiểm tra các đầu ra Trí tuệ Nhân tạo có khả năng đạo văn hoặc vi phạm bản quyền trước khi sử dụng công khai.

Biện pháp kiểm tra ngăn ngừa đạo văn trí tuệ nhân tạo

Dưới đây là một số biện pháp tốt cả nhà phát triển Trí tuệ Nhân tạo và người dùng có thể áp dụng để giảm thiểu rủi ro đạo văn:

Đối với nhà phát triển:

- Chú ý kiểm tra nguồn dữ liệu huấn luyện một cách cẩn thận để loại trừ vật liệu có bản quyền hoặc được cấp phép mà không có sự cho phép đúng đắn.

- Phát triển các quy trình tài liệu dữ liệu và theo dõi nguồn gốc một cách chặt chẽ. Ghi lại các siêu dữ liệu như giấy phép, thẻ, người tạo, v.v.

- Triển khai các công cụ phát hiện đạo văn để đánh dấu nội dung có rủi ro cao trước khi phát hành.

- Cung cấp báo cáo minh bạch chi tiết về nguồn dữ liệu huấn luyện, giấy phép và nguồn gốc của đầu ra Trí tuệ Nhân tạo khi có nghi ngờ.

- Cho phép người tạo nội dung quyết định không tham gia vào các bộ dữ liệu huấn luyện một cách dễ dàng. Nhanh chóng tuân thủ các yêu cầu loại bỏ hoặc ngừng sử dụng khi được yêu cầu.

Đối với người sử dụng:

- Kiểm tra kỹ lưỡng các đầu ra để phát hiện bất kỳ đoạn văn nào có khả năng bị đạo văn hoặc không được ghi nhận trước khi triển khai quy mô lớn.

- Tránh xử lý Trí tuệ Nhân tạo như là hệ thống sáng tạo hoàn toàn tự động. Hãy cho người xem xét cuối cùng xem xét nội dung.

- Ưu tiên sự sáng tạo được hỗ trợ bởi Trí tuệ Nhân tạo hơn là tạo nội dung hoàn toàn mới từ đầu. Sử dụng mô hình để diễn đạt lại hoặc đề xuất ý tưởng thay vì tạo hoàn toàn mới.

- Kiểm tra các điều khoản sử dụng, chính sách nội dung và biện pháp bảo vệ đối với đạo văn từ nhà cung cấp Trí tuệ Nhân tạo trước khi sử dụng. Tránh các mô hình mà tính mờ làm cho chúng khó hiểu.

- Trích dẫn nguồn rõ ràng nếu có bất kỳ vật liệu có bản quyền nào xuất hiện trong đầu ra cuối cùng mặc dù đã cố gắng hết sức. Đừng trình bày công việc của Trí tuệ Nhân tạo như là hoàn toàn gốc.

- Hạn chế chia sẻ đầu ra riêng tư hoặc bảo mật cho đến khi rủi ro đạo văn có thể được đánh giá và giải quyết thêm.

Có thể cần có các quy định về dữ liệu huấn luyện nghiêm ngặt hơn khi mô hình sáng tạo tiếp tục lan rộng. Điều này có thể bao gồm việc yêu cầu sự đồng ý tham gia từ người tạo nội dung trước khi công việc của họ được thêm vào các bộ dữ liệu. Tuy nhiên, trách nhiệm đè lên cả nhà phát triển và người sử dụng để sử dụng các thực hành Trí tuệ Nhân tạo có đạo đức, tôn trọng quyền của người tạo nội dung.

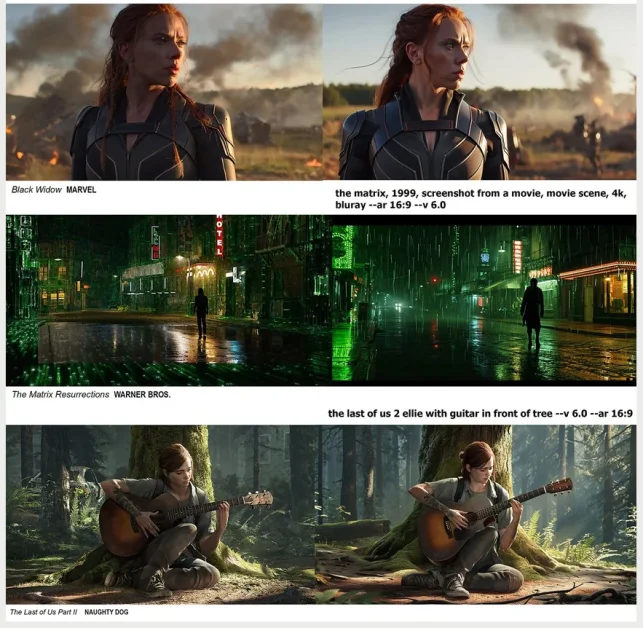

Đạo văn trong phiên bản Alpha V6 của Midjourney

Sau khi chỉ dùng một số yêu cầu hạn chế, mô hình V6 của Midjourney đã tạo ra những hình ảnh gần như giống hệt với các bức ảnh bản quyền từ phim, chương trình truyền hình và ảnh chụp màn hình trò chơi video có thể đã được bao gồm trong dữ liệu huấn luyện của nó.

Những thử nghiệm này tiếp tục xác nhận rằng ngay cả các hệ thống Trí tuệ Nhân tạo hình ảnh tiên tiến nhất cũng có thể đạo văn không biết đến nội dung được bảo vệ nếu nguồn dữ liệu huấn luyện không được kiểm tra. Điều này nhấn mạnh sự cần thiết của sự cảnh báo, biện pháp bảo vệ và sự giám sát của con người khi triển khai các mô hình sáng tạo trong môi trường kinh doanh để giới hạn rủi ro vi phạm bản quyền.

Phản ứng của công ty trí tuệ nhân tạo đối với nội dung có bản quyền

Ranh giới giữa sự sáng tạo của con người và Trí tuệ Nhân tạo đang mờ nhạt, tạo ra các vấn đề bản quyền phức tạp. Các tác phẩm kết hợp đầu vào từ con người và Trí tuệ Nhân tạo có thể chỉ có thể được bảo vệ bản quyền trong các khía cạnh thực hiện chỉ bởi con người.

Văn phòng Bản quyền Hoa Kỳ gần đây đã từ chối việc bảo vệ bản quyền cho hầu hết các khía cạnh của một tiểu thuyết đồ họa do cả người và Trí tuệ Nhân tạo thực hiện, xem nghệ thuật của Trí tuệ Nhân tạo như không phải của con người. Nó cũng ban hành hướng dẫn loại trừ các hệ thống Trí tuệ Nhân tạo khỏi ‘tác giả’. Tòa án liên bang xác nhận quan điểm này trong một vụ kiện bản quyền nghệ thuật Trí tuệ Nhân tạo.

Trong khi đó, các vụ kiện đưa ra cáo buộc vi phạm bản quyền bởi Trí tuệ Nhân tạo sáng tạo, như Getty v. Stability AI và nghệ sĩ v. Midjourney/Stability AI, nhưng mà không có ‘tác giả’ Trí tuệ Nhân tạo, một số người còn đặt ra câu hỏi liệu có áp dụng các yêu cầu về vi phạm bản quyền hay không.

Trong phản ứng lại, các công ty Trí tuệ Nhân tạo lớn như Meta, Google, Microsoft và Apple lập luận rằng họ không cần phải có giấy phép hoặc trả tiền bản quyền để huấn luyện mô hình Trí tuệ Nhân tạo trên dữ liệu có bản quyền.

Dưới đây là tóm tắt về các lập luận chính từ các công ty Trí tuệ Nhân tạo lớn đối với các quy tắc bản quyền mới có thể áp dụng cho Trí tuệ Nhân tạo ở Mỹ, với các nguồn tham khảo:

- Meta lập luận rằng áp đặt giấy phép hiện tại sẽ gây ra hỗn loạn và ít lợi ích cho người giữ bản quyền (Meta, năm 2022).

- Google cho rằng việc huấn luyện Trí tuệ Nhân tạo tương tự như các hành động không vi phạm bản quyền như đọc sách (Google, 2022).

- Microsoft cảnh báo rằng thay đổi luật bản quyền có thể làm tổn thương các nhà phát triển Trí tuệ Nhân tạo nhỏ (Microsoft, năm 2022).

- Apple mong muốn bản quyền cho mã nguồn được tạo ra bởi Trí tuệ Nhân tạo nhưng được kiểm soát bởi nhà phát triển con người.

Tổng thể, hầu hết các công ty phản đối các quy định giấy phép mới và giảm nhẹ mối lo ngại về việc các hệ thống Trí tuệ Nhân tạo tái tạo các tác phẩm được bảo vệ mà không có sự ghi nhận. Tuy nhiên, quan điểm này đang gây tranh cãi khi có các vụ kiện bản quyền Trí tuệ Nhân tạo và các cuộc tranh luận gần đây.

Các con đường cho đổi mới trí tuệ nhân tạo và chịu trách nhiệm

Khi những mô hình sáng tạo mạnh mẽ này tiếp tục phát triển, việc giảm thiểu rủi ro đạo văn là quan trọng để được chấp nhận rộng rãi. Một cách tiếp cận đa chiều là cần thiết:

- Cải cách chính sách xoay quanh minh bạch về dữ liệu huấn luyện, giấy phép và sự đồng ý của người tạo nội dung.

- Các công nghệ phát hiện đạo văn mạnh mẽ và quản trị nội bộ của các nhà phát triển.

- Tăng cường nhận thức của người sử dụng về rủi ro và tuân thủ các nguyên tắc Trí tuệ Nhân tạo đạo đức.

- Tiền lệ pháp lý rõ ràng và các trường hợp pháp lý xung quanh vấn đề bản quyền Trí tuệ Nhân tạo.

Với các biện pháp bảo vệ đúng đắn, sự sáng tạo được hỗ trợ bởi Trí tuệ Nhân tạo có thể phát triển một cách đạo đức. Nhưng rủi ro đạo văn không kiểm soát có thể làm suy giảm đáng kể niềm tin của công chúng. Điều quan trọng là giải quyết trực tiếp vấn đề này để thực hiện tiềm năng sáng tạo to lớn của Trí tuệ Nhân tạo mà vẫn tôn trọng quyền của người tạo nội dung. Đạt được sự cân bằng đúng đắn sẽ đòi hỏi phải chấp nhận một cách tiếp cận tích cực đối mặt với điểm mù đạo văn được tích hợp vào bản chất của mạng nơ-ron. Nhưng làm như vậy sẽ đảm bảo rằng những mô hình mạnh mẽ này không làm suy giảm sự sáng tạo con người mà chúng mục tiêu tăng cường.